兰德:深度伪造技术对信息战的影响

发布时间:2022-07-28随着人工智能技术的发展,越来越多成熟的人工智能技术被用于虚假信息活动。深度伪造视频、音频、图像、生成文本会对个人、社会和国家安全带来威胁。为此,2022年7月6日,兰德公司发布报告《人工智能、深度伪造和虚假信息》(Artificial Intelligence, Deepfakes, and Disinformation),旨在为政策制定者展示深度伪造威胁图景。报告分析了深度伪造视频、音频、图像和生成文本的底层技术和相关人工智能技术,深度伪造检测和应对技术进展,并为政策制定者提出了建议。

随着互联网的发展,虚假信息战争的主要根据可能就是一个简单的meme(网络流行语):社交媒体上分享的一张照片、一个视频或文本。计算机和人工智能技术的发展,为虚假信息生成和传播提供了新的工具和方法——deepfakes(深度伪造)。

深度伪造最早是指利用人工智能应用程序制作的逼真的合成、虚假音视频内容,这些合成的虚假图像、声音和视频内容可以描绘人们从未做过和从未发生过的事情,而且深度伪造图像和音视频可以模仿目标的面部表情、动作和语音的音调、色调、重音和节奏,非常逼真,很难区分和检测。

1.内容及分类

深度伪造内容分类

随着人工智能技术的发展,越来越多、成熟的人工智能技术开始用于虚假信息活动。深度伪造内容包括深度伪造视频、深度伪造声音克隆、深度伪造图像、深度伪造生成文本4大类。

1.1 深度伪造视频

深度伪造视频可以合成或修改视频中的人脸、表情、身体动作等。合成视频的图像主要是通过生成对抗网络(GAN)生成的。高度逼真的深度伪造视频需要大量的高端计算资源、时间、金钱和技巧。以2021年抖音国际版账户(Tom [@deeptomcruise])上传的汤姆克鲁斯深度伪造视频为例,在人工智能模型上训练的时间就花费了2个月。此外,需要一对NVIDIA RTX 800 GPU处理器(单个GPU的售价为5795美元);开发人员还需要一帧一帧地检查合成视频中是否有被怀疑的标志,比如眼睛眨的频率等。

随着时间的推移,创建深度伪造视频会变得越来越便宜,所需的训练时间也会越来越少。同时,生成的视频质量也越来越高,越来越逼真,变得更加难以分辨和检测。目前,已经有大量的网站开始提供深度伪造合成服务。

1.2 深度伪造声音克隆

声音克隆是深度伪造应用的另一个方向。目前已经有许多在线网站和手机应用可以让用户模拟名人的声音。2019年,欺诈者用深度伪造语音技术合成语音从英国一家能源公司的首席执行官处诈骗了24.3万美元。2020年,美国费城一用户称接到疑似儿子的电话(深度伪造合成音频),被诈骗900美元

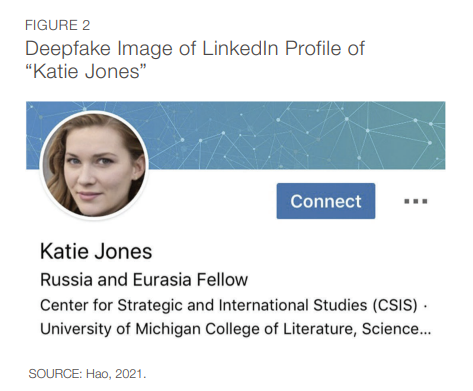

1.3 深度伪造图像

相比深度伪造视频,合成深度伪造图像的成本更低。深度伪造图像一般以人脸图片为主,看起来非常逼真,目前就有网站可以生成逼真的本不存在的人脸图片。下图是一个领英账户的个人简介,其中使用的照片就是深度伪造图片。深度伪造图片越来越多的被用于虚假社交媒体账户。

1.4 深度伪造生成文本

通过使用自然语言模型,人工智能还可以生成文本。2020年9月,Guardian就使用OpenAI开发的GPT-3生成了一篇文章。此外,GPT-3机器人还被用于在Reddit社区发帖超过1周时间,平均每分钟发1个帖。

有专家对此表示担忧,文本生成程序可能会被外国对手利用来规模化生成基于文本的宣传材料。对手也可能使用深度伪造文本生成技术就特定主题大规模生成虚假新闻,应用于信息战中。

2.威胁

威胁与影响使用的因素

2.1 威胁

第一,深度伪造内容可被用来操纵选举。比如,在选举即将结束时,一个证明候选人丑闻的视频会对选举结果带来影响。

第二,深度伪造内容可被用于加剧社会分裂。俄罗斯就利用虚假内容进行旨在分裂美国公众的宣传。

第三,深度伪造内容可降低民众对政府机构的信任。在伪造的逼真的政府官员视频加入暴力、种族歧视等内容会大大降低人们对政府机构的信任。

第四,深度伪造内容会侵蚀杂志和可信的信息源。利用高度可信的深度伪造视频,真实的视频内容也可能会被诽谤为深度伪造内容。

2.2 限制深度伪造大规模使用的因素

目前,深度伪造仍然没有大规模使用,主要原因是:

一是考虑到深度伪造的潜在威胁。

二是高质量的深度伪造视频仍然需要专业人员和工具制作,比如高成本的设备、训练用的视频内容、专业的技术人员等。

三是时间因素。用于虚假信息战的高度逼真的深度伪造视频制作往往需要数月甚至更长的时间。也就是说,需要提前数月来规划虚假信息活动。无法做到实时限制了该技术的应用。

四是深度伪造视频需要大量的训练数据。高质量的深度伪造需要上万张图片用于训练,这也是目前大多数深度伪造视频都是名人和政客的原因。

五是虚假信息的“0 day”(零日)。在虚假信息和深度伪造领域,0 day表示对手可以开发一个定制的生成模型来创建可绕过检测的深度伪造内容。对手想要尽可能长时间地绕过检测以最大化阅读量。检测工具也是在深度伪造内容上建立的,因此对手可能会尽可能地保留生成模型,等到关键时刻再使用,比如大选前一周。

六是深度伪造视频可能会被成功检测。

3.应对与建议

3.1 检测技术

目前应对方法:应对深度伪造视频的主要方法就是:开发和实现可以检测深度伪造视频的自动化系统。DARPA资助了两个与检测技术相关的项目:Media Forensics项目(2021年结束)和Semantic Forensics 项目(2021财年获得1970万美元,2022财年预算请求2340万美元)。2020年,Facebook启动了Deepfake Challenge Competition竞赛。

建议政策制定者应:收集情报并识别对手深度伪造的技术。使用深度伪造技术的对手会平衡机遇、益处、风险等做出决策。建议美国应当进行兵棋推演,识别可以影响对手决策的威慑战略。同时,情报机构应收集对手对深度伪造技术和创建深度伪造内容的投入情况相关的情报。投资并加强检测技术研究。美国政府、研究机构、社交媒体平台和其他利益相关方应继续投资并采取措施加强检测技术。关键措施包括创建深度伪造内容库,内容库可以促进检测技术的发展。同时,政府应与私有机构合作推广可以用于检测深度伪造视频的数据集。此外,政府和其他利益相关者还应探索对特定高性能深度伪造检测器的访问。

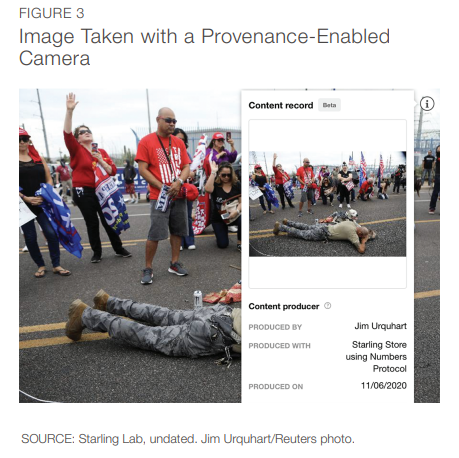

3.2 内容来源展示

目前应对方法:内容来源,即通过内容真实性计划(Content Authenticity Initiative),Adobe、高通、Trupic、纽约时报和其他参与者提出一种获取和展示照片源的方法。2022年1月,内容溯源与真实性联盟 (C2PA联盟/ Coalition for Content Provenance and Authority)建立了技术标准,指导创建者、编辑、媒体平台和消费者等实现内容来源的展示。

建议政策制定者应:推广基于展示的方法。C2PA联盟已经制定和发布了必要的技术说明,应扩大该技术的使用范围,确保信息来源的权威性。

3.3 监管措施

目前应对方法:通过监管和刑事立法应对深度伪造相关风险。自2019年以来,美国通过了多个州层面的深度伪造应对法案。在联邦层面,也提出了多个法案。但目前多个法案仍在提案阶段。

3.4 开源情报技术和新闻方法

目前应对方法:开源情报(OSINT)是美国中央情报局(CIA)的一种情报搜集手段,从各种公开的信息资源中寻找和获取有价值的情报,可以为解决深度伪造问题提供新的方法。这些方法的目标是开发和共享可以用来识别深度伪造和其他虚假信息相关内容的开源工具。

建议政策制定者应:开发新的OSINT工具。来帮助新闻机构、媒体机构和其他非技术专家检测和开展深度伪造内容研究。

3.5 媒介素养

目前应对方法:媒介素养(media literacy)项目帮助对信息源感兴趣的读者评估其可信性,并对展示的材料辩证地思考,大量证据表明媒介素养训练可以有效应对传统形式的虚假信息。

建议政策制定者应:继续开展媒介素养培训。促进更大范围的媒介素养技能和提高媒体应对虚假信息的能力,向受众警示深度伪造技术就在身边和深度伪造技术用于虚假信息的可能性。

4.评述

随着人工智能技术的发展,人工智能技术赋能的深度伪造内容也引来了发展热潮。深度伪造视频、音频、图像、文本等内容非常逼真,难以区分。兰德报告分析了深度伪造对政府、民主、社会等带来的威胁,以及当前限制深度伪造技术大规模使用的6个因素,提出了检测技术、内容来源展示、监管措施、开源情报技术和新闻方法、媒介素养等5种应对方法,最后为政策制定者提出了5个建议。

目前,全球各主要国家都开始意识到深度伪造内容对国家安全带来的潜在威胁,并从政策、技术等方面采取了应对措施。兰德报告提出的深度伪造虚假信息0 day(零日)风险为决策者和技术研究人员敲响了警钟,因为深度伪造的对抗可能是0 day的,如何实现0 day深度伪造内容检测可能是深度伪造检测技术研究的一大挑战。此外,兰德在原有深度伪造检测技术的基础上,提出的利用内容来源展示、开源情报技术和方法也为深度伪造技术应对提供了新的方向。

【参考链接】

https://www.rand.org/pubs/perspectives/PEA1043-1.html

https://www.rand.org/content/dam/rand/pubs/perspectives/PEA1000/PEA1043-1/RAND_PEA1043-1.pdf

来源:学术plus